Milano, 3 Dicembre 2025. L’atmosfera del WPC ha sempre un’energia particolare, ma quest’anno, per me, aveva un sapore diverso. È stato il mio primo WPC in veste di speaker.

Salire su quel palco non è solo condividere delle slide, è trasmettere la tua visione. Insieme alla mia collega e amica Laura Villa , abbiamo accettato una sfida ambiziosa, condensare in 50 minuti l’evoluzione di un paradigma che sta ridefinendo il business moderno, il “Real-Time”.

Il nostro obiettivo? Mettere a confronto due giganti dell’ecosistema Azure: Databricks e Microsoft Fabric. Non volevamo limitarci a un confronto tecnico, ma rispondere alla domanda che ogni architetto IT si pone oggi: quale strumento mi serve davvero per dominare la velocità del dato?

Differenti modi di processare i dati: Facciamo chiarezza

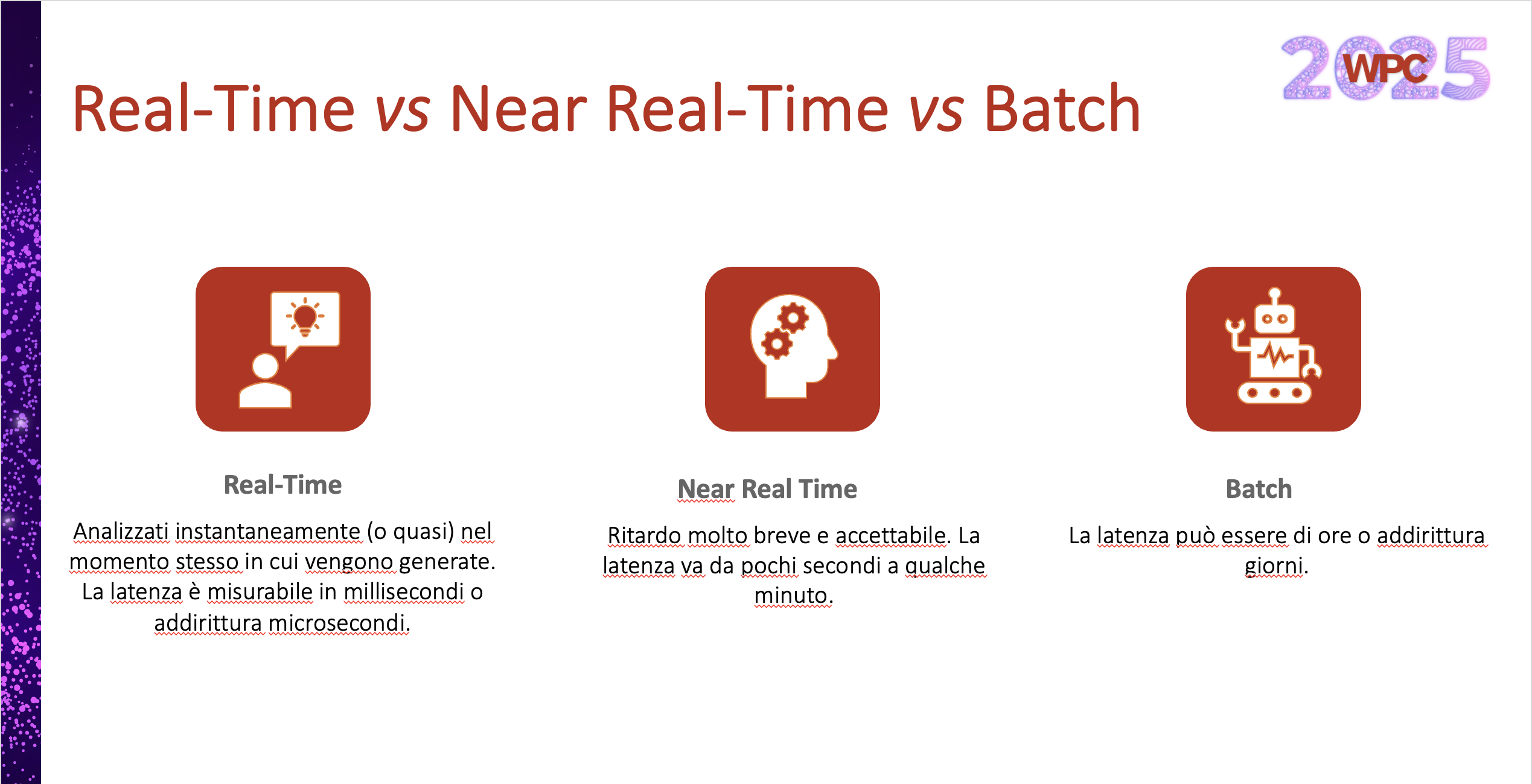

Prima di parlare di tecnologie, dobbiamo allinearci sul “vocabolario del tempo dei dati”. Spesso si abusa del termine “Real-Time”, per un professionista, le sfumature sono tutto.

Abbiamo distinto tre scenari, perché capire il requisito di latenza è il primo passo per non sbagliare architettura:

- Batch: Qui il dato “riposa”. Non c’è frenesia. Parliamo di processi schedulati (giornalieri, settimanali, mensili) dove la latenza non è un vincolo critico. È il regno della storicizzazione e del reporting consolidato.

- Near Real-Time: Il ritmo si alza. Per rientrare in questa categoria, l’elaborazione deve avvenire in una finestra che va da pochi secondi a qualche minuto. È lo standard per il monitoraggio operativo moderno.

- Real-Time: Parola chiave, Elaborazione istantanea. Qui la latenza si misura in millisecondi o microsecondi. È il territorio dove la velocità di reazione fa la differenza tra un guasto prevenuto e una linea di produzione ferma.

Il Caso d’Uso: Smart Building e IoT

Per rendere tangibile la teoria, abbiamo portato sul palco uno scenario reale: uno Smart Building. Immaginate un edificio disseminato di sensori che monitorano ogni respiro della struttura, produzione e consumo energetico, prestazioni dei macchinari, videocamere di sicurezza, sensori ambientali.

La sfida non è solo raccogliere i dati, ma trasformarli in decisioni mentre l’evento sta ancora accadendo.

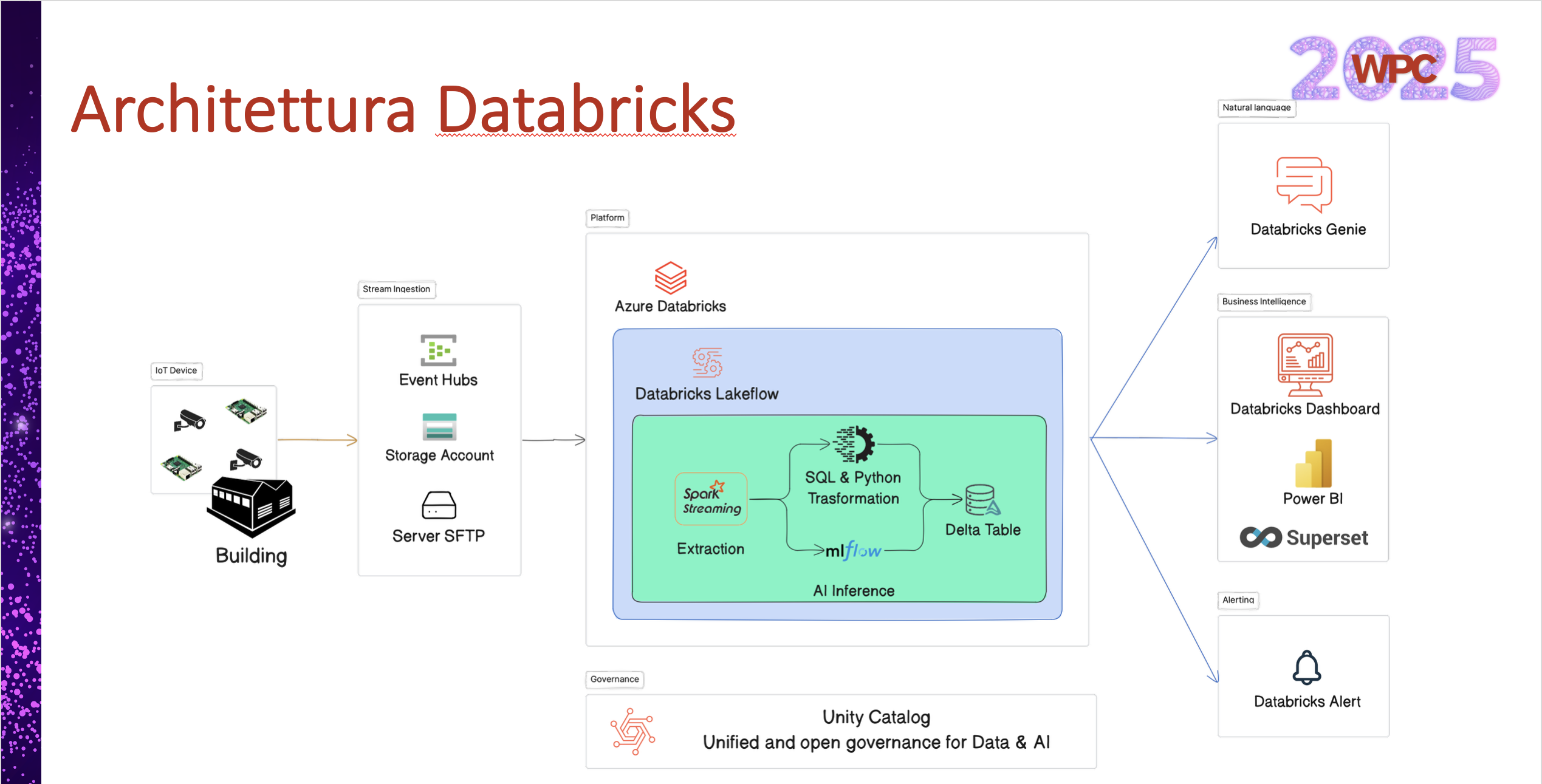

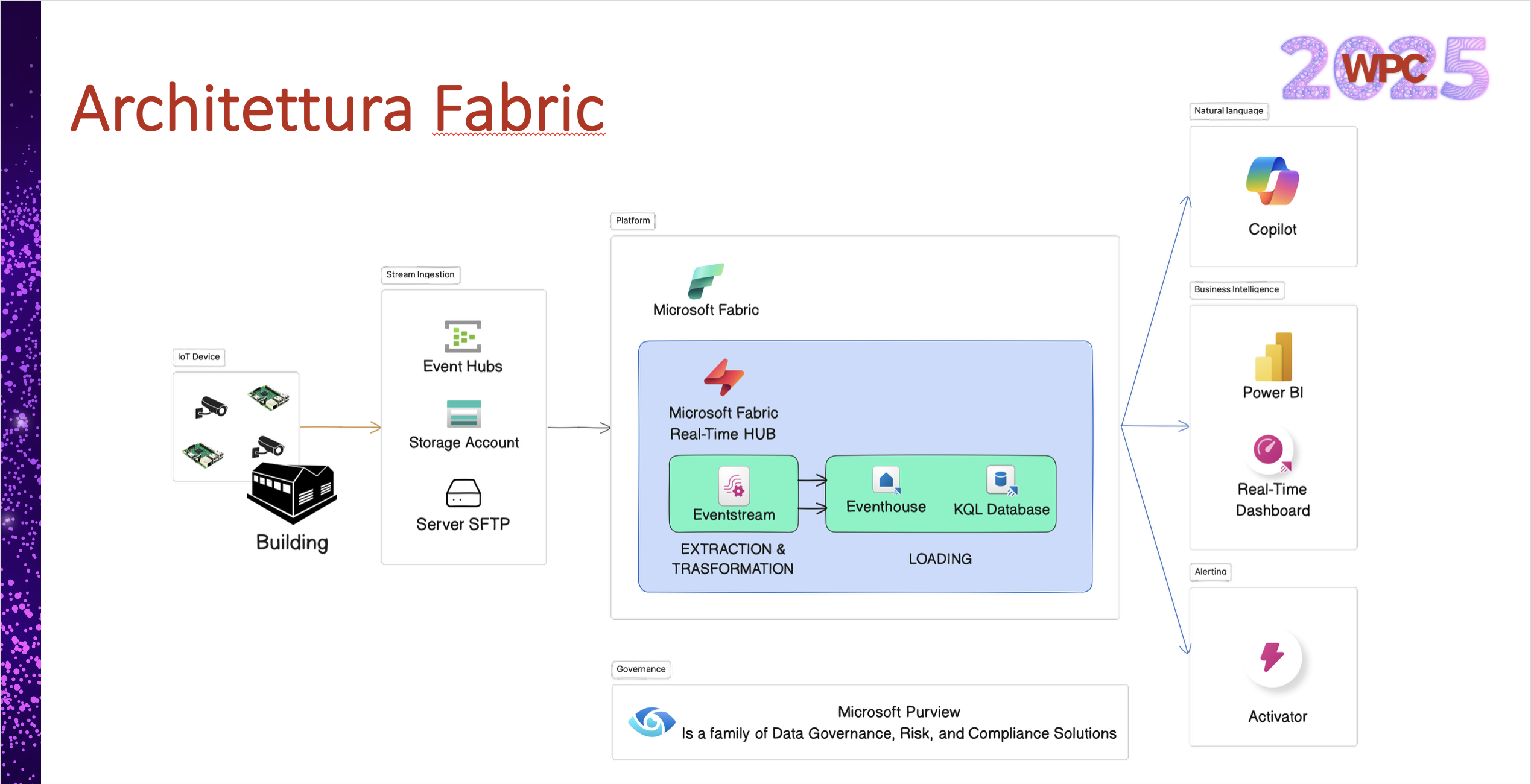

Nota Architetturale: Per entrambe le soluzioni, le sorgenti dati sono: Azure Event Hubs per lo streaming, server SFTP e Azure Blob Storage per i dati non strutturati.

Azure Databricks Architecture

Microsoft Fabric Architecture

Databricks: La potenza di Lakeflow

Quando parliamo di Databricks, parliamo di controllo e potenza ingegneristica. Per gestire lo streaming, Databricks ha esteso le feature dello Spark Declarative Framework tramite Lakeflow.

Lakeflow non è solo un tool, è un framework dichiarativo che permette di costruire pipeline (sia batch che streaming) robuste e scalabili, definendo le trasformazioni in SQL o Python.

Caratteristiche Principali

- Core Spark & Structured Streaming: Unifica batch e streaming su API standard. Gestione automatica dei checkpoint, fault-tolerance nativa e auto-scaling senza la necessità di ulteriori implementazioni.

- Orchestrazione Dichiarativa: Tu definisci il cosa (la logica di business), il sistema gestisce il come (dipendenze, retry, esecuzione).

- Data Quality Nativa: Le Expectations sono integrate nella pipeline. La validazione del dato e l’osservabilità non sono un “dopo”, sono parte del flusso.

- Elaborazione Incrementale: Grazie alle Streaming Tables, l’ingestion è continua.

Microsoft Fabric: La certezza chiamata Kusto

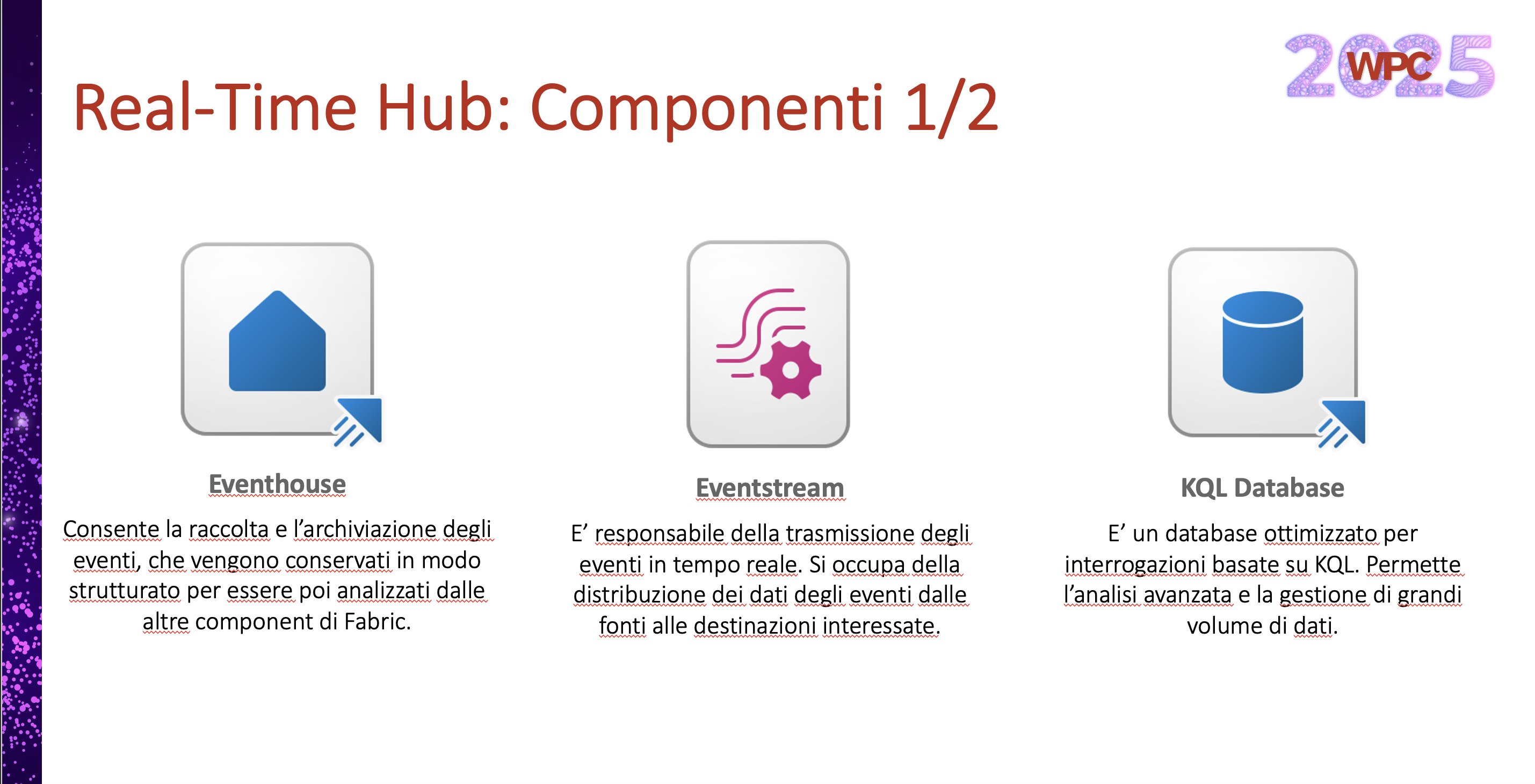

Passando a Microsoft Fabric, l’approccio cambia radicalmente. Qui la parola d’ordine è integrazione. Troviamo un Hub centrale dedicato al Real-Time, dove il cuore pulsante è l’engine KQL (Kusto Query Language).

Il Real-Time Hub di Fabric offre un ambiente unificato. Connettori integrati, visualizzazione immediata e azione diretta sugli stream.

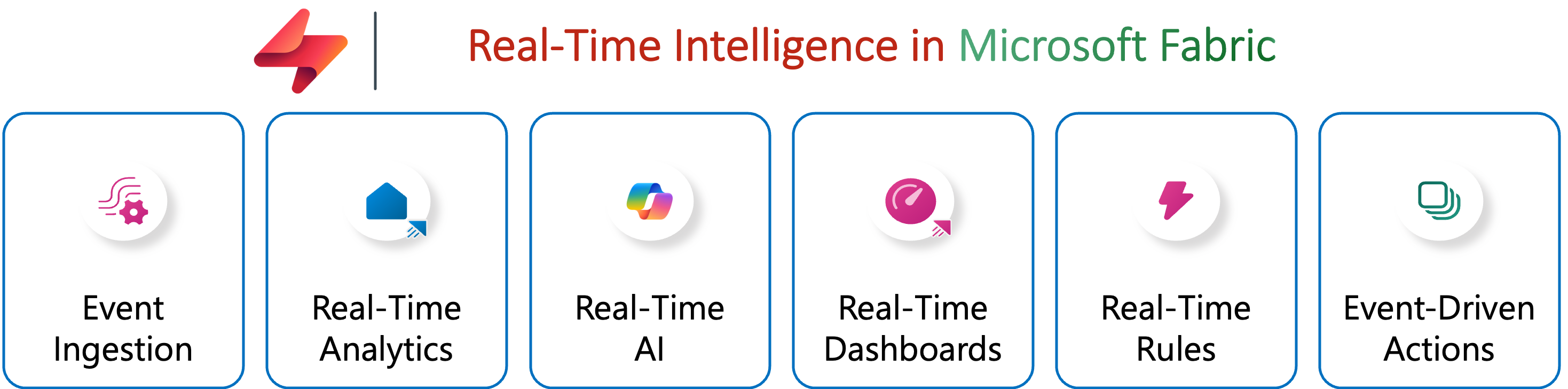

L’Ecosistema Real-Time di Fabric

La forza di Fabric sta nella sinergia dei suoi componenti:

- Eventhouse: Il magazzino intelligente. Raccoglie e archivia gli eventi in modo strutturato, rendendoli immediatamente disponibili per l’analisi.

- Eventstream: Il sistema nervoso. È responsabile della trasmissione e distribuzione degli eventi dalle fonti alle destinazioni in tempo reale.

- KQL Database: Il motore. Un database ottimizzato per le Time-Series e interrogazioni KQL rapidissime su enormi volumi di dati.

- Real-Time Dashboard: Porta la visualizzazione dinamica oltre i limiti del classico BI, supportando decisioni operative istantanee.

- Activator: Il braccio operativo. Non si limita a mostrare il dato, ma agisce. Avvia processi, invia notifiche o esegue comandi automatici al verificarsi di specifiche condizioni.

Il Verdetto: Quale scegliere?

Torniamo alla domanda che ha aperto il nostro talk al WPC: qual è la piattaforma migliore?

La risposta onesta, da professionista, è: dipende dal tuo obiettivo primario.

- Scegli Databricks se: Cerchi la massima flessibilità ingegneristica. Basandosi su Apache Spark, Databricks si distingue quando devi sviluppare pipeline complesse e customizzate. Inoltre, in scenari dove la latenza estrema è il fattore critico, la nuova “Real-Time Mode” è una dimostrazione di forza bruta impressionante.

- Scegli Fabric se: Vuoi velocità di implementazione e integrazione (Low-Code/No-Code). L’engine Kusto è un punto cardine per l’analisi delle time-series con primitive native. La capacità di passare dal dato grezzo a una Real-Time Dashboard in pochi clic è un vantaggio competitivo enorme per il business.

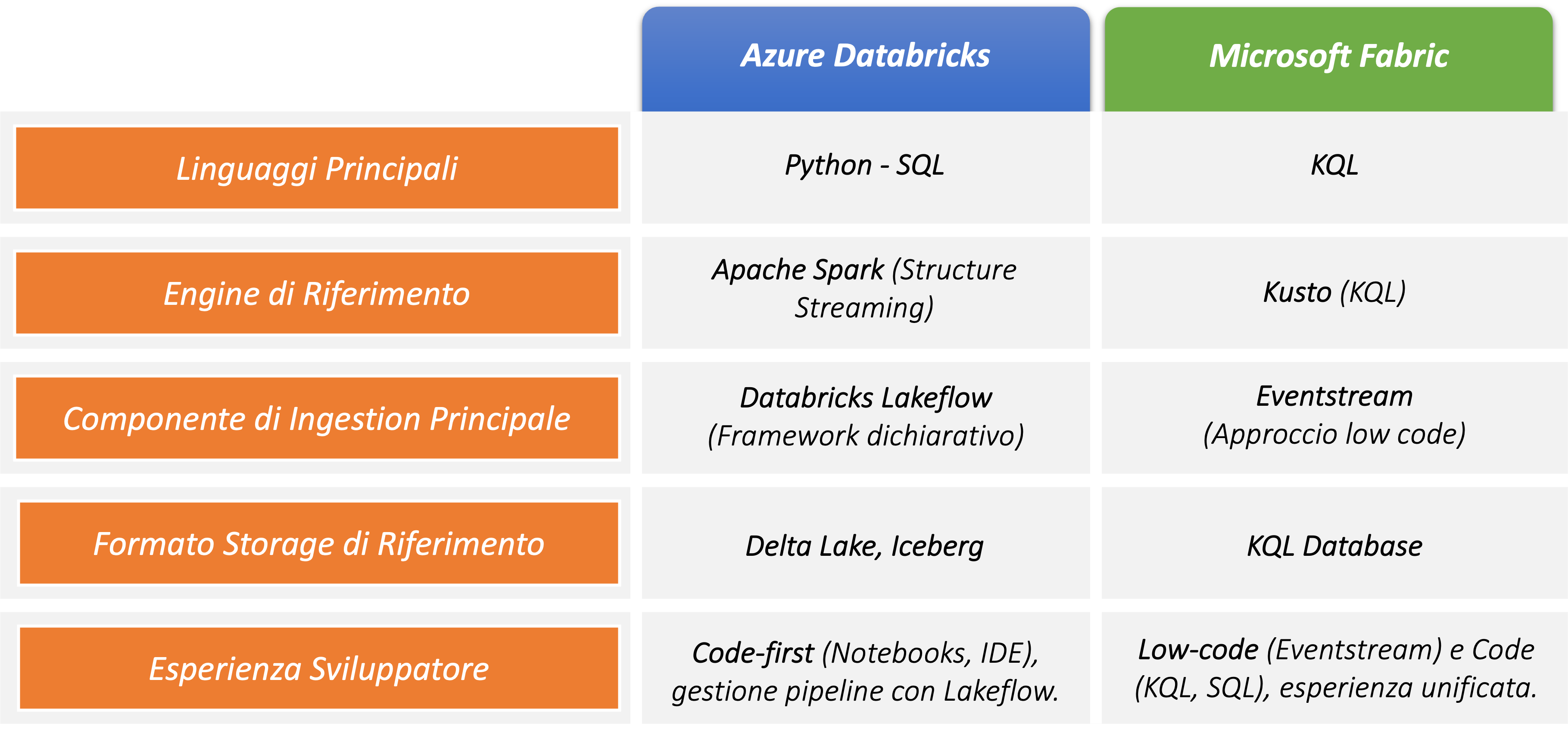

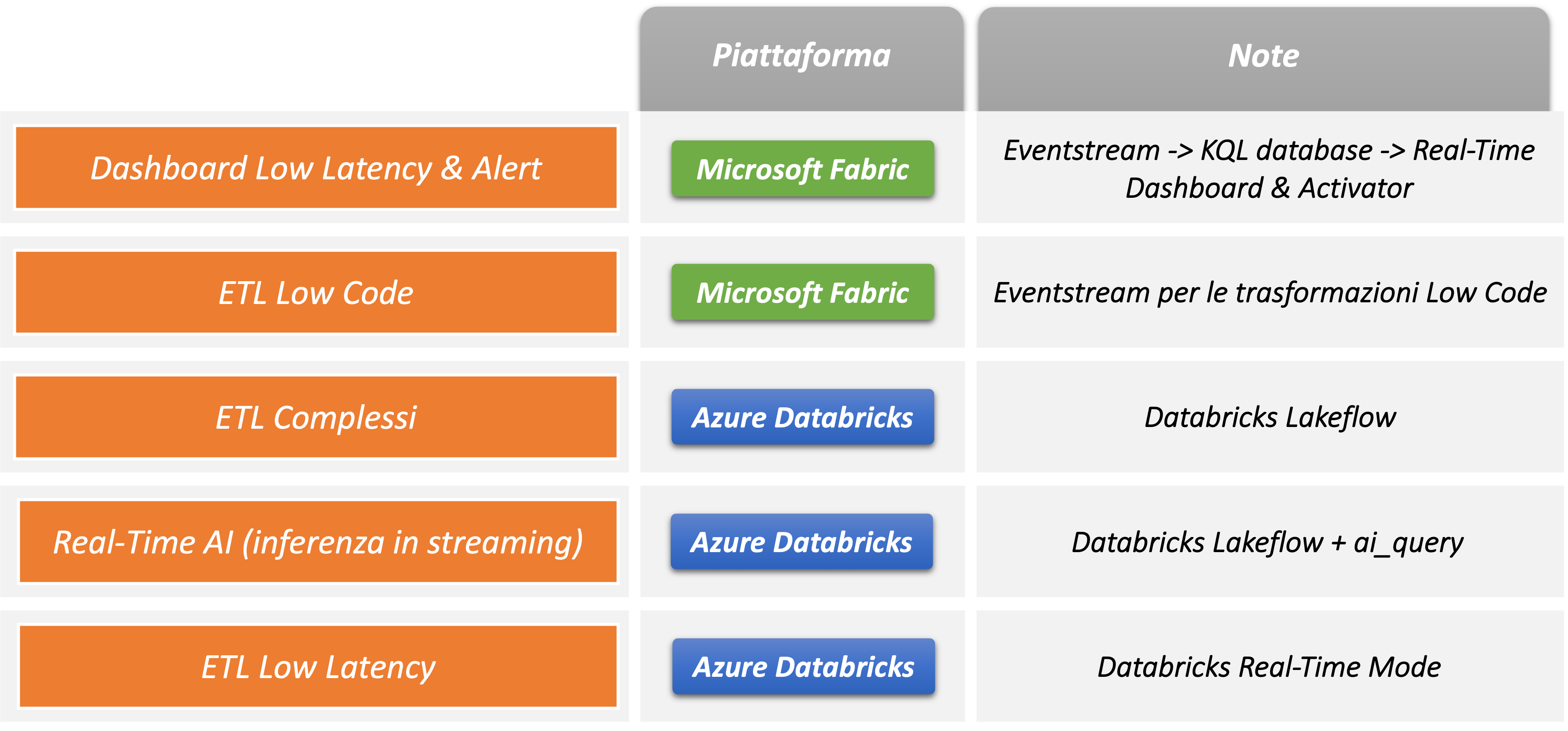

Confronto

Per aiutarvi nella scelta, abbiamo sintetizzato le caratteristiche chiave e i casi d’uso consigliati in queste due slide:

La scelta vincente: La Sinergia

Concludo con una provocazione che è anche un consiglio: e se non dovessimo per forza scegliere? La soluzione migliore, budget e competenze permettendo, potrebbe essere l’adozione di entrambe le piattaforme.

Databricks e Fabric stanno dimostrando di poter lavorare in incredibile sinergia. Sfruttare la potenza di calcolo di Spark per la preparazione del dato complesso e l’immediatezza di Kusto e Fabric per l’analisi e l’azione operativa ci permette di prendere il meglio dai due mondi.

Il WPC è stato un’esperienza incredibile, e il confronto tra queste Piattaforme è appena iniziato.

E voi, quale approccio state utilizzando nei vostri progetti Real-Time? Parliamone su LinkedIn .